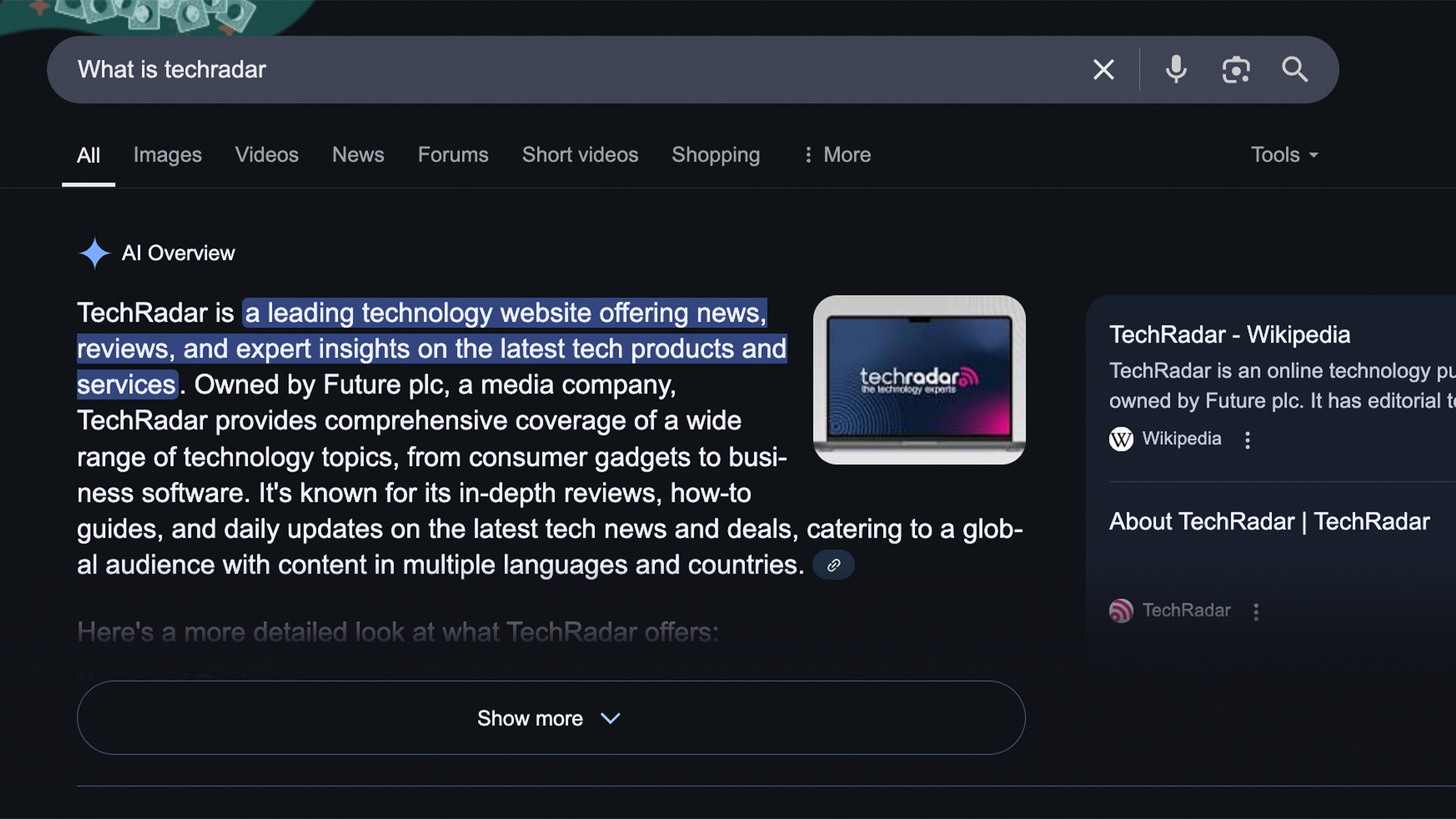

최근에, 당신은 마법의 단어에 대한 사랑스러운 작은 다이아몬드 로고로 당신을 만나기 위해 구글을 봤습니까? Google의 검토는 Google Gemini의 언어 모델 (답변 생성)을 관련 정보를 수신하는 검색의 세대와 결합합니다.

이론적으로 그는 놀라운 제품, Google 검색 엔진을 만들었으며 훨씬 쉽고 빠르게 사용했습니다.

그러나 이러한 이력서의 생성은 2 단계 프로세스이므로 언어의 검색과 생성 사이에 차이가있을 때 문제가 발생할 수 있습니다.

받은 정보는 정확할 수 있지만 AI는 이력서를 생성 할 때 잘못된 점프를하고 이상한 결론을 도출 할 수 있습니다.

예를 들어, 2024 년 중반에 치즈가 홈 피자에서 미끄러지지 않도록하는 방법으로 접착제를 추천하기 위해 인터넷에서 웃음이되었을 때 유명한 감독이 이루어졌습니다. 그리고 우리는 가위로 달리는 것이“심박수를 개선하고 농도와 농도가 필요한 심장 운동”이라고 묘사하는 시간을 좋아했습니다.

그들은 Google 검색 책임자 인 Liz Raid가 지난주에 대해이 사례들은 “우리가 개선해야 할 특정 영역을 식별했다”고 진술했다. 더욱이, 그녀는 외교적으로“무의미한 요청”과“풍자적 인 내용”을 고발했다.

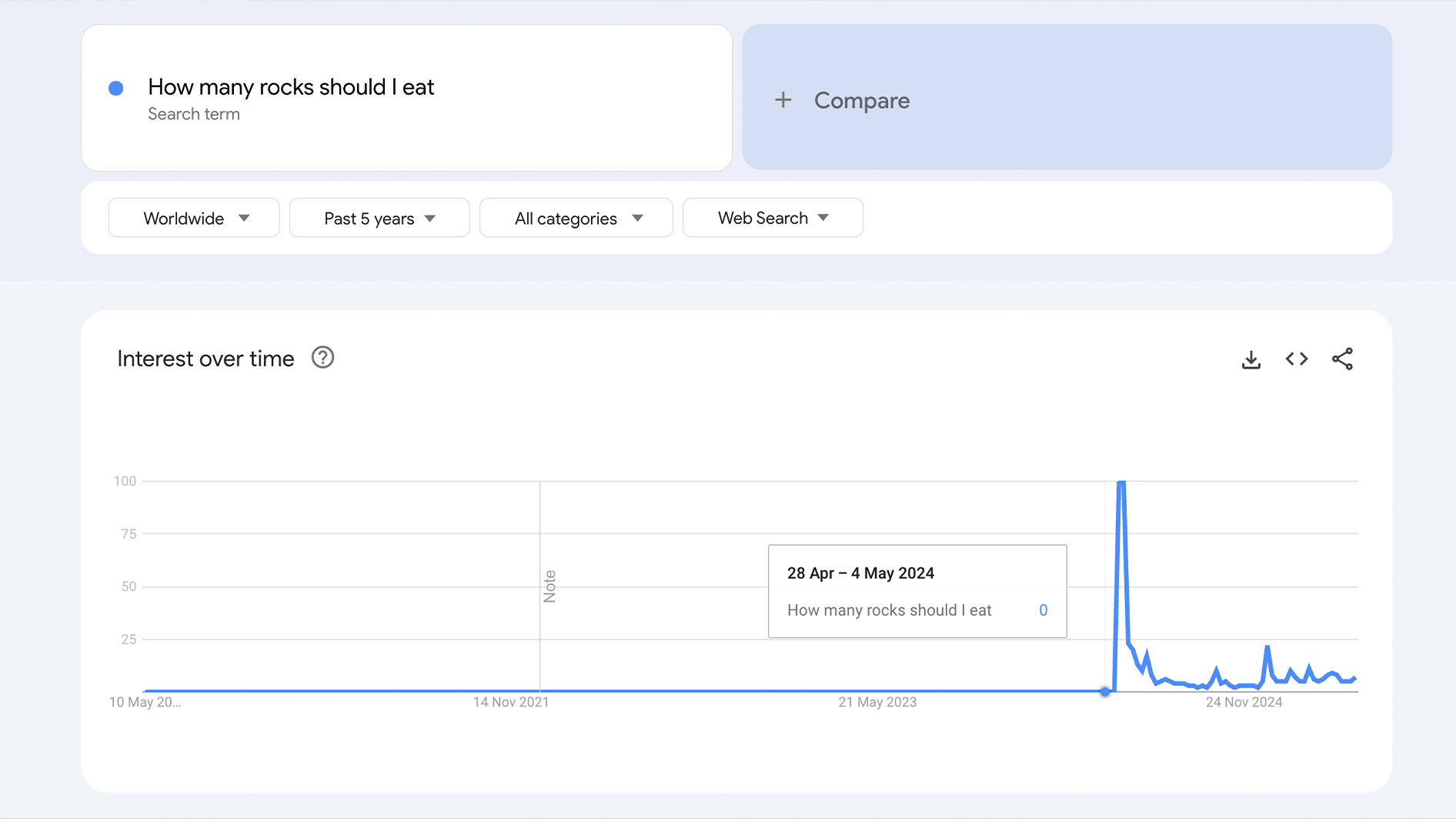

그녀는 적어도 부분적으로 옳았다. AI가 바보처럼 보였을 때 문제가있는 요청 중 일부는 관심사에서 강조되었습니다. 아래에서 어떻게 “얼마나 많은 돌을 먹어야합니까?” 나는 AI 리뷰를 발표하기 전에 정기적으로 검색 한 것이 아니었고 그 이후로 이것은 아니었다.

그럼에도 불구하고, Fiasco Pizza 이후 거의 1 년이 지난 후에도 사람들은 여전히 정보 제조 또는 AI에 대한 “환각”-명령에 대해 Google에서 AI 검토를 속이는 것을 여전히 속입니다.

많은 오해의 소지가있는 요청은 무시 된 것으로 보이지만 지난 달에만 AI 리뷰는“피자와 결혼 할 수 없다”또는“바셋 -온다 노트북을 문지르지 말라”와 같은 명백한 관용구에 대한 설명을 구성한다고 말했다.

따라서, 당신이 이것을 의도적으로 속일 때 AI는 종종 잘못됩니다. 큰 것. 그러나 이제는 수십억 달러가 사용되었으며 크라우드 소싱에 관한 의료위원회가 포함되어 있습니다. 진정한 질문으로 인해 환각으로 이어질 때 어떻게됩니까?

AI를 사용하는 모든 사람들이 자신의 정보를 얻는 곳에서 공부하는 경우 AI는 훌륭하게 작동하지만, 대부분의 사람들이 아닌 경우 많은 사람들이 이것을하지 않을 것입니다.

그리고 이것이 주요 문제입니다. 작가로서, 리뷰는 이미 자연에 의해 약간 성가시다. 나는 Man이 쓴 내용을 읽고 싶기 때문이다. 그러나 숙박 시설을 따로 지연 시켜도 AI는 너무 쉬운 경우 심각하게 문제가됩니다. 그리고 아마도, 아마도, 아마도 검색 할 때 주로 어디에나있을 때 완전히 위험 해졌으며 사용자의 특정 부분이 순수한 동전에 대한 정보를 가져갈 것입니다.

나는 수색의 수년이 우리 모두가 페이지 상단의 결과를 신뢰하도록 가르쳐 주었다는 것을 의미합니다.

잠깐만 … 그게 사실인가요?

많은 사람들처럼, 나는 때때로 변화와 싸울 수 있습니다. LeBron이 Lakers에 갔을 때 나는 그것을 좋아하지 않았고, 나는 너무 오랫동안 iPod을 통해 MP3 플레이어와 갇혀있었습니다.

그러나 이제 이것이 대부분 Google에서 볼 수있는 첫 번째 일이라는 점을 감안할 때 AI Google의 리뷰는 무시하기가 조금 더 어렵습니다.

나는 그것을 Wikipedia로 사용하려고 노력했지만 잠재적으로 신뢰할 수 없지만 잊혀진 정보를 상기 시키거나 100% 정확하지 않은 경우 Agita로 이끌지 않는 주제의 근거를 연구하는 것이 좋습니다.

그럼에도 불구하고 겉보기에 간단한 요청에 따르면 효과적으로 실패 할 수 있습니다. 예를 들어, 지난주에 영화를 보았고이 남자는 정말 Lin-Manuel Miranda (뮤지컬 제작자 해밀턴), 그래서 나는 그가 형제가 있다면 gotogled.

ASI 리뷰는“예, Lin-Manuel Miranda에는 세바스찬과 프란시스코라는 두 명의 남동생이 있습니다.”라고 말했습니다.

몇 분 안에 나는 내가 사람들을 인정하는 데 천재라고 생각했다.

그에게 의심의 이점을주고 싶을 때, 나는 그가 헤드 라인을 만들도록 도와주기 위해 Star Wars의 인용문에 아무런 문제가 없다고 생각했습니다.

다행히도, 이것은 내가 필요한 것을 정확하게 주었다. “안녕하세요!” 그리고“이것은 함정입니다!”, 심지어“아니요, 나는 당신의 아버지입니다.”라고 인용했습니다.“루크, 나는 당신의 아버지입니다.

그러나이 법적 인용문과 함께, 이것은 Anakin이 다음과 같이 말했습니다.

나는 그것이 어떻게 그렇게 잘못 될 수 있는지에 충격을 받았다. 그리고 나는 나 자신에 대해 추측하기 시작했다. 나는 내가 틀릴 것이라고 생각하는 것에 대해 생각하고있다. 트리플이 인용문의 존재를 확인했는지 확신하지 못했습니다. 그리고 그는 이것을 사무실과 공유했다.

스타 워즈처럼 어리석은 일에 관한이 작은 자기 의심은 나를 무서워했다. 내가 요청한 주제에 대해 몰랐다면 어떻게해야합니까?

SE 등급에 전념 한이 연구는 실제로 Google의 AI 검토가 금융, 정치인, 건강 및 법의 주제를 피하거나 반응한다는 것을 보여줍니다. 이것은 Google을 의미합니다 그는 알고 있습니다 AI가 아직 더 심각한 질문을하지 않았다는 사실.

그러나 Google이 그렇게 할 수있는 정도로 개선되었다고 생각하면 어떻게됩니까?

이것은 기술이지만 우리가 그것을 사용하는 방법

Google을 사용하는 모든 사람이 인공 지능의 결과를 두 번 확인하거나 검토에서 제공 한 초기 링크를 클릭하도록 신뢰할 수있는 경우 부정확성은 문제가되지 않습니다.

그러나 더 간단한 옵션이있는 한, 마찰없이 더 많은 옵션이있는 한, 사람들은 원칙적으로 그것을 취하십시오.

인류의 역사에서 이전보다 더 많은 정보가 있다는 사실에도 불구하고, 많은 국가에서 우리의 문해력과 계정 기술이 줄어 듭니다. 2022 년 연구에 따르면 미국인의 48.5%만이 최소한 읽는 것으로보고했습니다. 하나 이 책은 지난 12 개월입니다.

이것은 기술 자체가 아니라 문제입니다. 그랜트 블라쉬 카 조교수가 설득력있게 말하면서, 우리가 기술을 어떻게 사용하는지 (그리고 실제로 우리가 그것을 사용하는 방법), 이곳은 문제가 발생하는 곳입니다.

예를 들어, 캐나다 맥길 대학교 (Canadian University of McGill)의 연구원들이 수행 한 관찰 연구에 따르면 일반 실무자들의 정기적 인 사용은 공간 기억의 악화로 이어질 수 있으며 독립적으로 탐색 할 수 없다는 것이 밝혀졌습니다. 나는 Google 카드를 사용하여 어딘가에 도착했으며 어떻게 돌아올 지 전혀 몰랐습니다.

Neuronauk은 투쟁이 뇌에 유용하다는 것을 분명히 보여주었습니다. 인지 부하 이론은 당신의 뇌가 생각하다 배워야 할 것들에 대해. 질문을 찾을 때 너무 많은 사람들이 싸우고 있다고 상상하기는 어렵습니다. AI 이력서를 읽은 다음 낮에는 이름을 지정합니다.

생각할 선택을하십시오

다시는 GPS를 사용하지 않지만 AI Google의 리뷰를 고려하여 정기적으로주의를 기울일 자격이 없습니다. AI의 리뷰를 제거 할 수 있습니다. 그럼에도 불구하고 불행히도 지금은 그러한 방법이 없습니다.

카키조차도 귀하의 요청에 갑작스러운 단어를 추가 할 때 더 이상 작동하지 않습니다. (그리고 F- 단어의 사용은 여전히 대부분의 시간에 작동하는 것처럼 보이지만, 더 이상하고 다른“성인에 대한 지향적”검색 결과를 위해서도 그것을 찾고 있습니다.)

물론 Google이기 때문에 여전히 Google을 사용하겠습니다. 가까운 시일 내에 그는 AI에 대한 야망을 바꾸지 않을 것이며, AI의 리뷰를 포기할 기회를 회복하기를 원하지만 악마를 아는 것이 낫습니다.

현재 AI 정보에 대한 유일한 진정한 방어는 사용하지 않도록 조정 된 노력을 기울이는 것입니다. 이것은 당신의 근무 회의에 대해 메모하거나 몇 줄의 픽업을 만들어 내도록하십시오. 그러나 정보의 출처로 사용하는 것과 관련하여, 나는 그것을 스크롤하고 최상의 결과에서 품질 (또는 적어도 입증 된) 기사를 검색했습니다.

앞서, 나는 일단 이러한 도구가 신뢰할 수있는 정보원이 될 수 있다고 언급했다. 그들은 심지어 정치를 받아 들일만큼 똑똑 할 수도 있습니다. 그러나 오늘은 잘못된 날입니다.

실제로, 뉴욕 타임즈 (New York Times)는 5 월 5 일에보고 된 바와 같이, 구글과 chatgpt 도구가 더욱 강력 해지 기 때문에 점점 더 신뢰할 수 없게되기 때문에 어떤 종류의 정치 후보의 정책을 일반화한다고 믿을 때 확실하지 않습니다.

이러한 “추론 시스템”의 환각 수준을 테스트 할 때 가장 등록 된 환각 수준은 79%였습니다. 인공 지능 및 기업 보조 플랫폼의 대리인 인 Vectara의 전무 이사 인 Amr Awadalla는 “우리의 노력에도 불구하고 항상 환각을 줄 것”이라고 직접 말했다.